Вибуховий розвиток технології генеративного штучного інтелекту розпочався наприкінці 2022 року із запуском ChatGPT від OpenAI. А вже через рік ця технологія може стати найбільш зарегульованою у галузі. По всьому світу, від США до ЄС і Бразилії, законодавці терміново розглядають, а у випадку Китаю ухвалюють правила для контролю ШІ.

ЄС, ймовірно, стане першим регіоном, який запровадить певну форму регулювання технології генеративного ШІ. Європейська комісія, до складу якої входять два десятки країн, перебуває на фінальній стадії переговорів щодо Закону про штучний інтелект, який вона назвала “першими у світі правилами щодо штучного інтелекту”. Очікується, що остаточна версія Закону про штучний інтелект буде погоджена до кінця цього року, тобто він набуде чинності наприкінці 2025 року.

Деякі інструменти ШІ можуть бути заборонені в ЄС

Закон був уперше запропонований у 2021 році, до того, як OpenAI запустив свої інструменти генеративного штучного інтелекту ChatGPT і DALL-E. Невдовзі тренд підхопили й такі компанії, як Meta, Google і Microsoft та стали активними гравцями цього ринку.

Тож у 2023-му проєкт закону було оновлено. Наразі ключовою зміною, яку вводить закон, є класифікація моделей та інструментів ШІ відповідно до ризику: низький або мінімальний, високий та неприйнятний. Категорія ШІ-інструментів високого ризику включає біометричну ідентифікацію, освіту, управління працівниками, правову систему та правоохоронні органи, а також будь-який інструмент, який потрібно буде оцінити та схвалити перед запуском.

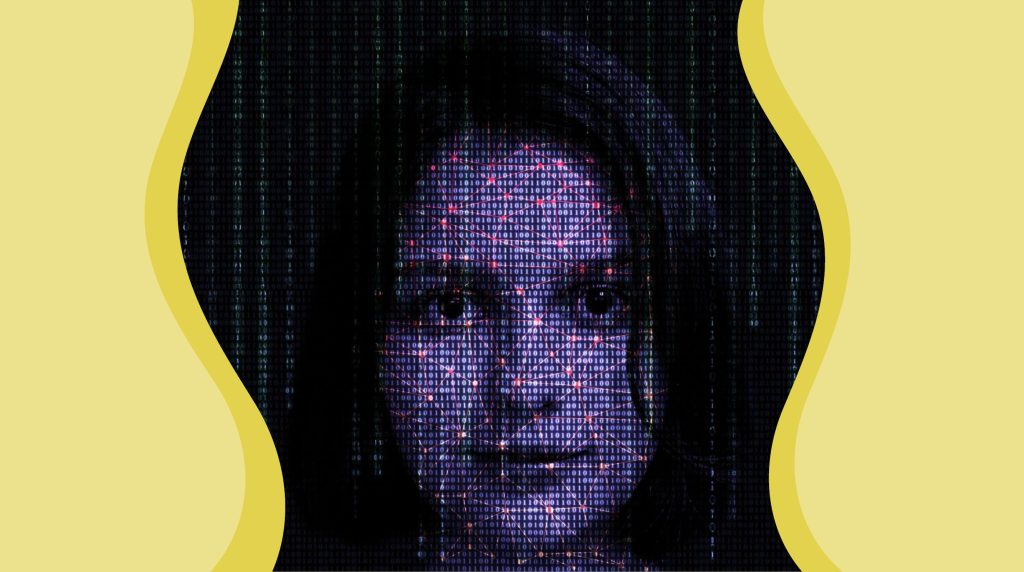

Інструменти штучного інтелекту, визнані “неприйнятними”, будуть заборонені в ЄС. Сюди входять “системи дистанційної біометричної ідентифікації” або технологія розпізнавання обличчя, “соціальна оцінка” або класифікація людей на основі економічного класу та особистих характеристик, а також “когнітивні поведінкові маніпуляції”, як-от голосові іграшки на основі ШІ.

ВАС ТАКОЖ ЗАЦІКАВИТЬ - ЄС готує нормативну базу для регулювання ШІ. Чи працюють над цим в Україні?

Що стосується генеративного ШІ, то згідно із запропонованими правилами ЄС обов’язково необхідно буде вказувати, якщо контент створений за допомогою штучного інтелекту. Також компанії зобов’яжуть розкривати дані, які використовувалися для навчання будь-якої великої мовної моделі. Ця вимога пов’язана, зокрема, з судовими позовами з боку авторів та інших творців контенту, який було зібрано в інтернеті та використано для створення масивів навчальних даних.

Компанії також повинні будуть продемонструвати, що вони працювали над зменшенням юридичних ризиків, перш ніж запускати нові інструменти та моделі, і реєструвати всі базові моделі в базі даних, якою управляє Комісія ЄС.

Підхід США

США відстають від ЄС, коли йдеться про регулювання ШІ. У вересні Білий дім заявив, що “розробляє виконавчий наказ” щодо технології та впровадить двопартійне законодавство щодо регулювання ШІ. Поки Білий дім звертався за порадою до експертів галузі, Сенат скликав одне слухання та провів один закритий “Форум штучного інтелекту” з лідерами великих технологічних компаній. Жодна подія не призвела до розробки конкретної регуляторної бази. Тим не менш, американські законодавці кажуть, що вони працюють над “певною формою регулювання ШІ”.

Також у США можуть бути внесені правки в Закон про авторське право. У серпні Бюро авторських прав заявило, що розглядає можливість введення нових федеральних правил щодо генеративного штучного інтелекту через “публічні дебати про те, що ці системи можуть означати для майбутнього креативних індустрій”. До листопада триватиме громадське обговорення правок.

Що відбувається у Великій Британії

Тим часом Велика Британія хоче стати “наддержавою ШІ”, як зазначається у березневому документі її Департаменту науки, інновацій та технологій. Незважаючи на те, що у Великій Британії було створено “регуляторну пісочницю для штучного інтелекту”, країна наразі не має наміру запроваджувати будь-яке нове законодавство для контролю технології.

“Прийнявши закон занадто рано, ми ризикуємо покласти надмірний тягар на бізнес”, — зазначала Мішель Доннелан, державний секретар з питань науки, інновацій і технологій. “У міру розвитку технології наш регуляторний підхід може змінитися”.

Бразилія та Китай

Бразилія дотримується подібного до ЄС підходу до класифікації інструментів штучного інтелекту відповідно до ризику і заборонить ті, які входять до категорії “надмірного ризику” в оновленому проєкті закону. Останній характеризується юристами як “орієнтований на права людини”, але водночас такий, що окреслює режим “суворої відповідальності”.

Бразилія має намір притягувати до відповідальності творців LLM за шкоду, заподіяну будь-якою системою штучного інтелекту, яка вважається “високоризиковою”.

Китай став першою країною, в якій були офіційно введені нові правила щодо ШІ. Незважаючи на широке використання в цій країні таких речей, як розпізнавання обличчя для державного стеження, Китай за останні два роки запровадив правила щодо алгоритмів рекомендацій (це основний варіант використання штучного інтелекту). Новий же закон регулює генеративний ШІ. Одна з його ключових вимог полягає в тому, що будь-яка LLM та її навчальні дані мають бути “правдивими та точними”. Експерти зазначають, що однієї цієї вимоги вистачить для того, щоб зупинити розвиток генеративного штучного інтелекту в країні.