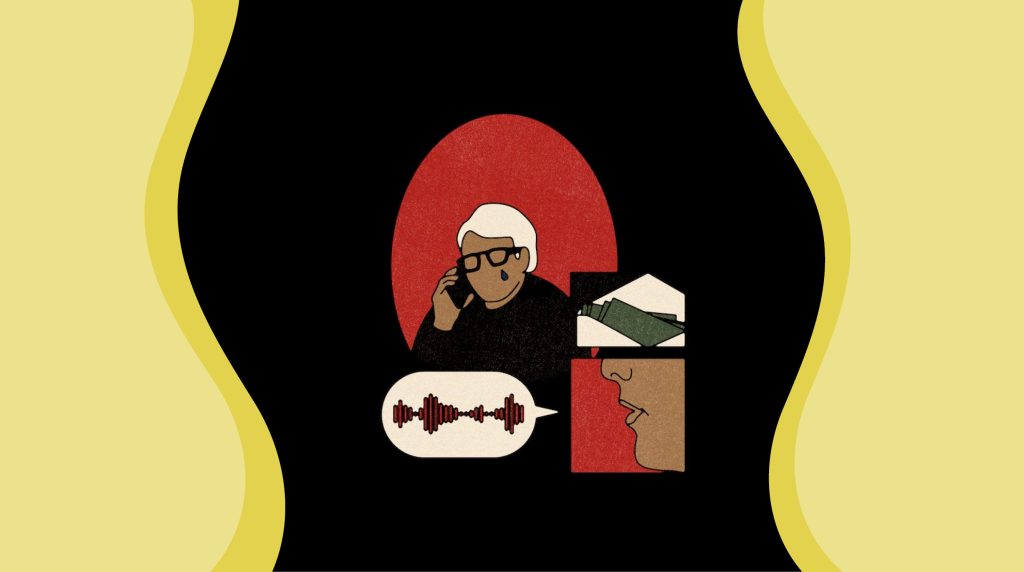

Шахраї все частіше застосовують технології імітації голосу на базі штучного інтелекту для шантажу родичів жертв. Про це пише Washington Post.

У Сполучених Штатах зростає кількість випадків шахрайства за участю самозванців. Сучасні технології на базі штучного інтелекту полегшують і здешевлюють аферистам процес імітування голосів, переконуючи жертв, часто літніх, що їхні близькі в біді.

За даними Федеральної торгової комісії США (FTC), у 2022 році шахрайство за участю самозванців стало другим за популярністю в країні. За вказаний період було отримано понад 36 000 повідомлень про те, що людей обдурили аферисти, які видають себе за друзів та родичів. Понад 5100 із цих інцидентів сталися по телефону, у результаті них було заподіяно збитків на суму $11 млн.

Досягнення в галузі штучного інтелекту надали шахраям нові інструменти відтворення голосу. Безліч дешевих онлайн-сервісів на базі ШІ можуть перетворити короткий аудіофайл на копію голосу, дозволяючи шахраю змусити його озвучувати будь-який текст.

Експерти вважають, що регулятори та правоохоронці мають не достатньо засобів запобігання такому виду шахрайства. Також більшість жертв не має зачіпок, що дозволяли б ідентифікувати злочинців.